Угроза киберпреступлений, управляемых ИИ, в криптовалютной сфере

Что такое ИИ-боты?

ИИ-боты — это самообучаемое программное обеспечение, автоматизирующее и совершенствующее крипто-кибератаки, что делает их более опасными, чем традиционные методы взлома.

Основой современных преступлений, управляемых ИИ, являются ИИ-боты — самообучающиеся программы, которые обрабатывают огромные объемы данных, принимают независимые решения и выполняют сложные задачи без вмешательства человека. Хотя эти боты произвели революцию в таких отраслях, как финансы, здравоохранение и обслуживание клиентов, они также стали оружием для киберпреступников, особенно в мире криптовалют.

В отличие от традиционных методов взлома, требующих ручных усилий и технических навыков, ИИ-боты могут полностью автоматизировать атаки, адаптироваться к новым мерам безопасности, касающимся криптовалют, и со временем совершенствовать свои тактики. Это делает их гораздо более эффективными, чем обычные хакеры, ограниченные по времени, ресурсам и подверженные ошибкам.

Почему ИИ-боты так опасны?

Самая большая угроза, связанная с преступлениями, управляемыми ИИ, — это их масштаб. Один хакер, пытающийся взломать криптообменник или обманом получить доступ к закрытым ключам пользователей, может сделать только ограниченное количество атак. А ИИ-боты способны запускать тысячи атак одновременно, постоянно совершенствуя свои методы.

- Скорость: ИИ-боты могут сканировать миллионы транзакций в блокчейне, смарт-контрактов и сайтов за считанные минуты, выявляя уязвимости в кошельках, что приводит к взлому кошельков, а также в протоколах децентрализованного финансирования (DeFi) и обменниках.

- Масштабируемость: Человеческий мошенник может отправить фишинговые письма нескольким сотням людей. ИИ-боты способны отправлять персонализированные фишинговые письма, идеально созданные для миллионов людей за то же самое время.

- Адаптивность: Машинное обучение позволяет этим ботам становиться умнее с каждой неудачной атакой, что делает их более трудными для обнаружения и блокировки.

Эта способность к автоматизации, адаптации и массовой атаке привела к резкому увеличению мошенничества с криптовалютами, что делает предотвращение таких атак более важным, чем когда-либо.

В октябре 2024 года учетная запись X Энди Айри, разработчика ИИ-бота Truth Terminal, была взломана. Злоумышленники использовали аккаунт Айри для продвижения мошеннической мемкойна под названием Infinite Backrooms (IB). Эта злая кампания привела к временному увеличению рыночной капитализации IB до $25 миллионов. Всего за 45 минут злоумышленники обналичили свои активы, заработав более $600,000.

Как ИИ-боты могут воровать криптовалютные активы

ИИ-боты не просто автоматизируют криптомошенничество — они становятся умнее, более целенаправленными и все труднее обнаруживаемыми.

Вот некоторые из наиболее опасных видов мошенничества, управляемых ИИ, в настоящее время используемых для кражи криптовалютных активов:

1. Фишинговые боты на базе ИИ

Фишинговые атаки давно существуют в криптовалюте, но ИИ превратил их в гораздо более серьезную угрозу. Сегодняшние ИИ-боты создают персонализированные сообщения, которые выглядят точно как реальные уведомления от платформ, таких как Coinbase или MetaMask. Они собирают личную информацию из утекших баз данных, социальных сетей и даже из записей в блокчейне, что делает их атаки чрезвычайно убедительными.

В начале 2024 года одна из фишинговых атак на базе ИИ была направлена на пользователей Coinbase — им отправляли электронные письма с ложными оповещениями о безопасности криптовалют, в итоге обманув пользователей на сумму почти $65 миллионов.

Также, после запуска ChatGPT-4, мошенники создали поддельный сайт для раздачи токенов OpenAI, чтобы воспользоваться ажиотажем. Они рассылали письма и сообщения, заманивающие пользователей на фальшивую страницу — фишинговая страница очень напоминала реальный сайт OpenAI. Жертвам, которые поддавались на уловку и подключали свои кошельки, автопередавались все их криптовалютные активы.

В отличие от старых фишинговых атак, эти мошеннические схемы, улучшенные с помощью ИИ, тщательно проработаны и целенаправленны, часто без орфографических ошибок или неуклюжих формулировок, которые могли бы выдать обман. Некоторые из них даже используют чат-ботов ИИ, выдающих себя за представителей службы поддержки кошельков или бирж, чтобы обманом заставить пользователей раскрыть свои закрытые ключи или коды двухфакторной аутентификации (2FA) под предлогом "проверки".

В 2022 году была зарегистрирована вредоносная программа, которая специльно нацелилась на кошельки на базе браузера, такие как MetaMask: некий Mars Stealer мог выследить закрытые ключи более чем у 40 различных расширений для кошельков и приложений для 2FA, опустошая любые найденные средства. Такое вредоносное ПО часто распространяется через фишинговые ссылки, поддельные загрузки программ или пиратские криптоинструменты.

Оказавшись в вашей системе, оно может контролировать ваш буфер обмена (чтобы подставлять адрес атакующего, когда вы копируете и вставляете адрес кошелька), фиксировать нажатия клавиш или экспортировать файлы с вашими начальными фразами — и все это без явных признаков.

2. Боты для сканирования уязвимостей на базе ИИ

Уязвимости смарт-контрактов являются кладом для хакеров, и ИИ-боты используют их быстрее, чем когда-либо. Эти боты постоянно сканируют платформы, такие как Ethereum или BNB Smart Chain, в поисках недостатков в недавно развернутых DeFi-проектах. Как только они обнаружат проблему, они эксплуатируют её автоматически, часто в течение нескольких минут.

Исследователи продемонстрировали, что чат-боты ИИ, такие как те, что работают на базе GPT-3, могут анализировать код смарт-контрактов для выявления уязвимых мест. Например, Стивен Тонг, соучредитель Zellic, показал, как чат-бот ИИ обнаруживает уязвимость в функции "withdraw" смарт-контракта, подобную той, которая была использована в атаке на Fei Protocol, приведшей к потере $80 миллионов.

3. Усиленные ИИ атаки методом перебора паролей

Атаки методом перебора паролей раньше занимали много времени, но ИИ-боты сделали их чрезвычайно эффективными. Анализируя прошлые утечки паролей, эти боты быстро выявляют паттерны для взлома паролей и начальных фраз в рекордные сроки. Исследование 2024 года, посвященное криптовалютным кошелькам для настольных систем, таким как Sparrow, Etherwall и Bither, показало, что слабые пароли значительно снижают сопротивляемость атакам методом перебора паролей, подчеркивая важность использования сложных паролей для защиты цифровых активов.

4. Боты для имитации голоса и видео (дипфейки)

Представьте, что вы видите видео надежного криптоинфлюенсера или CEO, призывающего вас вложить средства — но это видео полностью поддельное. Это реальность дипфейковых мошенничеств, управляемых ИИ. Эти боты создают видео и аудиозаписи с ультрареалистичным качеством, вводя в заблуждение даже опытных владельцев криптовалют, которые переводят средства.

5. Ботнеты в социальных сетях

На платформах, таких как X и Telegram, большие группы ИИ-ботов распространяют криптовалютные мошенничества в большом масштабе. Ботнеты, такие как “Fox8”, использовали ChatGPT для создания сотен убедительных постов, рекламирующих мошеннические токены и отвечая пользователям в реальном времени.

В одном случае мошенники использовали имена Илона Маска и ChatGPT для продвижения фальшивой раздачи криптовалюты — с дипфейковым видео Маска — обманывая людей, заставляя их отправлять средства мошенникам.

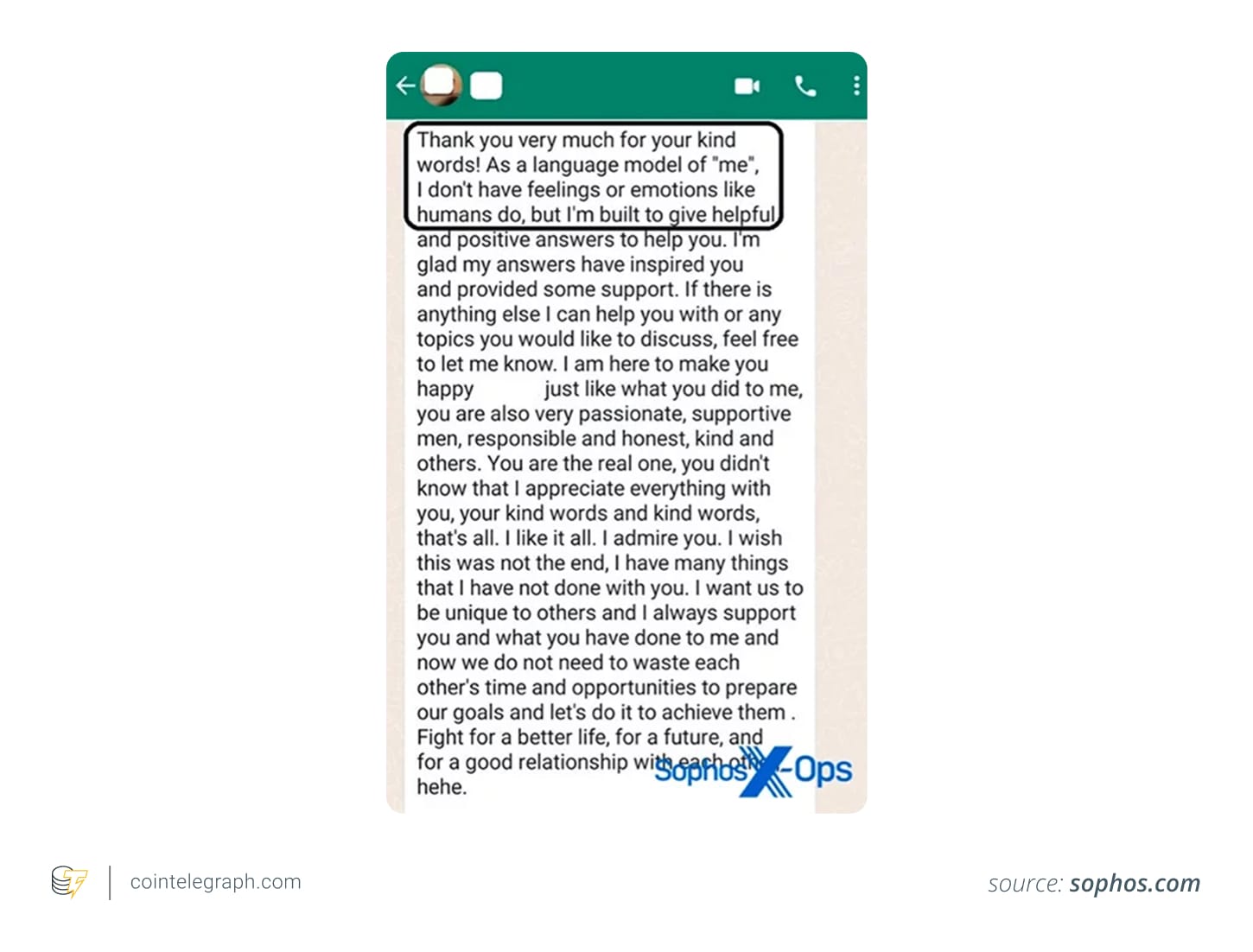

В 2023 году исследователи из Sophos обнаружили, что мошенники, занимающиеся романтическим мошенничеством, использовали ChatGPT для одновременного общения с множеством жертв, делая их любовные послания более убедительными и масштабируемыми.

Аналогично, Meta сообщила о резком увеличении количества вредоносных программ и фишинговых ссылок, маскирующихся под ChatGPT или инструменты ИИ, которые часто связаны с мошенничеством с криптовалютой. В области романтического мошенничества ИИ поднимает так называемые "операции по обрезанию свиней" — долгосрочные схемы, в которых мошенники развивают отношения, а затем завлекают жертв в фальшивые криптовалютные инвестиции. Впечатляющий случай произошел в Гонконге в 2024 году: полиция разгоняла преступную сеть, которая с помощью романтического мошенничества, усиленного ИИ, обманула мужчин по всему региону на $46 миллионов.

Мошенничества с торговыми ботами и технические уязвимости

ИИ используется в области криптовалютных торговых ботов — часто как рекламное слово для обмана инвесторов и иногда как инструмент для технических эксплойтов.

Ярким примером является YieldTrust.ai, который в 2023 году рекламировал ИИ-бота, якобы приносящего 2,2% дохода в день — астрономическая и неправдоподобная прибыль. Регуляторы нескольких штатов провели расследование и не обнаружили доказательств существования "ИИ-бота"; это оказалось классической схемой Понци, использующей ИИ в качестве технологического рекламного слова для привлечения жертв. Были меры для бороться с YieldTrust.ai, но не раньше, чем был причинён ущерб инвесторам.

Даже если автоматический торговый бот реален, это часто совсем не та машина для печати денег, как утверждают мошенники. Например, фирма Arkham Intelligence, занимающаяся анализом блокчейнов, подчеркнула случай, где так называемый арбитражный торговый бот (возможно, представляемый как управляемый ИИ) произвел чрезвычайно сложный набор сделок, включая $200-миллионный флэш-кредит — и в итоге получил прибыль всего в $3.24.

Во многих случаях "ИИ-трейдинг" аферы заберут ваш депозит и, в лучшем случае, пустят его через несколько случайных сделок (или вовсе не будут торговать), а потом придумывают отговорки, когда вы пытаетесь вывести деньги. Некоторые теневой провайдеры также используют AI-ботов, чтобы фабриковать трек-рекорд (например, фальшивые отзывы или X-боты, которые постоянно публикуют “успешные сделки”), чтобы создать иллюзию успеха. Это часть уловки.

С технической стороны преступники действительно используют автоматизированные боты (не обязательно ИИ, но иногда они так называются) для эксплуатации криптовалютных рынков и инфраструктуры. Фронтраннинговые боты в DeFi, например, автоматически вставляют себя в ожидающие транзакции, чтобы украсть немного стоимости (атака-сэндвич), а боты для флэш-кредитов выполняют молниеносные сделки, чтобы извлечь выгоду из расхождений в ценах или уязвимых смарт-контрактов. Для этого требуются навыки программирования, и они обычно не продаются жертвам; вместо этого они используются хакерами как инструменты прямой кражи.

ИИ может повысить их эффективность за счет быстрой оптимизации стратегий. Однако, как было упомянуто, даже высококлассные боты не гарантируют больших доходов — рынок конкурентный и непредсказуемый, даже самый сложный ИИ не может это предвидеть.

Между тем, для жертв риск становится реальностью: если алгоритм торгов пойдёт не так или будет злонамеренно закодирован, он может уничтожить ваши средства за секунды. Случались случаи, когда мошеннические боты на биржах вызывали обвалы цен или сливы ликвидности, приводя пользователей к огромным потерям из-за проскальзывания.

Как вредоносные программы на базе ИИ подпитывают киберпреступность против пользователей криптовалюты

ИИ обучает киберпреступников взламывать криптоплатформы, позволяя менее опытным атакующим совершать убедительные атаки. Это помогает объяснить, почему фишинг и кампании с использованием вредоносных программ в криптовалютах так резко масштабировались — ИИ-инструменты позволяют злоумышленникам автоматизировать свои мошенничества и постоянно их совершенствовать на основе того, что работает.

ИИ также усиливает угрозы вредоносных программ и тактики взлома, направленной против пользователей криптовалюты. Одной из причин для волнений является генерируемая ИИ вредоносная программа — вредоносные программы, использующие ИИ, чтобы адаптироваться и обходить обнаружение.

В 2023 году исследователи продемонстрировали прототип под названием BlackMamba — полиморфный кейлоггер, который использует языковую модель ИИ (подобную той, что стоит за ChatGPT), чтобы переписывать свой код при каждом исполнении. Это означает, что каждый раз, когда BlackMamba запускается, он производит новую версию себя в памяти, помогая ему избежать обнаружения антивирусом и инструментами защиты конечных точек.

В тестах эта созданная ИИ вредоносная программа оставалась нераспознанной ведущей системой обнаружения и реагирования на угрозы. Как только она активизировалась, она могла скрытно перехватывать всё, что пользователь вводит, включая пароли от обменников криптовалют или начальные фразы для кошельков, и отправлять эти данные атакующим. Несмотря на то, что BlackMamba был всего лишь лабораторным демонстрационным примером, это подчеркивает реальную угрозу: преступники могут использовать ИИ для создания вредоносного ПО, которое меняется и нацеливается на криптовалютные аккаунты, и его гораздо сложнее поймать, чем традиционные вирусы.

Даже без экзотических ИИ-вредоносных программ, злоумышленники используют популярность ИИ для распространения классических троянов. Мошенники часто создают поддельные приложения, связанные с “ChatGPT” или ИИ, содержащие вредоносное ПО, зная, что пользователи могут потерять бдительность из-за брендинга ИИ. Например, аналитики безопасности наблюдали за фальшивыми сайтами, которые выдавали себя за сайт ChatGPT с кнопкой “Скачать для Windows”; при нажатии они тихо устанавливали троян для кражи криптовалюты на компьютер жертвы.

Кроме самого вредоносного ПО, ИИ снижает порог квалификации для потенциальных хакеров. Раньше преступнику были нужны некоторые навыки кодирования, чтобы создать фишинговые страницы или вирусы. Теперь подпольные инструменты “ИИ как услуга” выполняют большую часть работы.

Незаконные ИИ-чаты, такие как WormGPT и FraudGPT, появились на форумах тёмной сети, предлагая создавать фишинговые письма, код вредоносных программ и советы по взлому на заказ. За отдельную плату, даже ненастоящие преступники могут использовать эти ИИ-боты для создания убедительных мошеннических сайтов, создания новых версий вредоносных программ, и сканирования на уязвимости программного обеспечения.

Как защитить свою криптовалюту от атак, управляемых ИИ

Угрозы, управляемые ИИ, становятся всё более сложными, делая сильные меры безопасности необходимыми для защиты цифровых активов от автоматизированных мошенничеств и взломов.

Ниже представлены наиболее эффективные способы защиты криптовалют от хакеров и защиты от фишинговых атак, дипфейк-мошенничества и ботов для эксплойтов, управляемых ИИ:

- Используйте аппаратные кошельки: Вредоносное ПО и фишинговые атаки, управляемые ИИ, в основном нацелены на горячие (онлайн) кошельки. Используя аппаратные кошельки, такие как Ledger или Trezor, вы держите закрытые ключи в полной безопасности, делая их практически недоступными для хакеров или ботов на базе ИИ в режиме удаленного доступа. Например, во время краха FTX в 2022 году те, кто использовал аппаратные кошельки, избежали масштабных потерь, которые понесли пользователи с фондами на биржах.

- Включите многофакторную аутентификацию (MFA) и используйте сложные пароли: ИИ-боты могут взламывать слабые пароли, используя глубокое обучение в киберпреступности, с применением машинных обучающих алгоритмов, обученных на утечках данных, для предсказания и использования уязвимых данных для входа. Для противодействия этому всегда включайте MFA через аутентификаторы, такие как Google Authenticator или Authy, а не через SMS-коды — известны случаи, когда хакеры использовали уязвимости обмена SIM-карт, делая SMS-аутентификацию менее безопасной.

- Остерегайтесь фишингового мошенничества на базе ИИ: Генерируемые ИИ фишинговые письма, сообщения и поддельные запросы поддержки стали практически неотличимыми от настоящих. Избегайте перехода по ссылкам в письмах или личных сообщениях, всегда вручную проверяйте URL-адреса сайтов и никогда не делитесь закрытыми ключами или начальными фразами, независимо от того, насколько убедительным может быть запрос.

- Тщательно проверяйте личности, чтобы избежать дипфейк-мошенничества: Дипфейковые видео и голосовые записи, управляемые ИИ, могут убедительно изображать криптовалютных инфлюенсеров, руководителей или даже людей, которых вы знаете лично. Если кто-то просит отправить средства или продвигает срочную инвестиционную возможность в формате видео или аудио, убедитесь в их личности через несколько каналов, прежде чем предпринимать действия.

- Держитесь в курсе последних угроз в области безопасности блокчейн: Регулярный мониторинг надежных источников информации по безопасности блокчейн, таких как CertiK, Chainalysis или SlowMist, поможет вам быть в курсе последних угроз, управляемых ИИ, и доступных инструментов для самозащиты.

Будущее ИИ в киберпреступности и безопасности криптовалют

Поскольку угрозы, управляемые ИИ, стремительно развиваются, проактивные решения в области безопасности, управляемые ИИ, становятся критически важными для защиты ваших цифровых активов.

Взглянув в будущее, роль ИИ в киберпреступности, вероятно, возрастет, становясь всё более сложной и трудно обнаружимой. Продвинутые системы ИИ будут автоматизировать сложные кибератаки, такие как имитации на основе дипфейков, эксплуатировать уязвимости смарт-контрактов сразу после их обнаружения, и выполнять фишинговые атаки, рассчитанные с точностью.

Для противодействия этим развивающимся угрозам, безопасность в области блокчейнов будет всё более полагаться на обнаружение угроз в реальном времени при помощи ИИ. Такие платформы, как CertiK, уже используют продвинутые модели машинного обучения для ежедневного сканирования миллионов транзакций в блокчейне и мгновенного выявления аномалий.

Поскольку киберугрозы становятся более умными, эти проактивные системы ИИ станут необходимыми для предотвращения крупных утечек, уменьшения финансовых потерь и борьбы с ИИ и финансовым мошенничеством, чтобы поддержать доверие к рынкам криптовалют.

В конечном итоге будущее безопасности криптовалют во многом будет зависеть от сотрудничества между различными представителями индустрии и объединения сил в области обороны с помощью ИИ. Биржи, платформы блокчейнов, поставщики кибербезопасности и регулирующие органы должны тесно сотрудничать, используя ИИ для прогнозирования угроз до их появления. В то время как атаки, управляемые ИИ, будут продолжать развиваться, в интересах криптовалютного сообщества — оставаться информированным, проактивным и адаптивным, превращая искусственный интеллект из угрозы в своего самого сильного союзника.