Военные США использовали Anthropic при ударе по Ирану, несмотря на запрет Трампа — WSJ

Американские военные, как сообщается, использовали решения Anthropic во время крупного авиаудара по Ирану — всего через несколько часов после того, как президент Дональд Трамп распорядился прекратить использование систем компании федеральными ведомствами.

Командования, включая Центральное командование США (CENTCOM) на Ближнем Востоке, применяли модель Claude для оперативной поддержки, сообщает The Wall Street Journal со ссылкой на источники, знакомые с ситуацией. По данным собеседников издания, инструмент помогал в анализе разведданных, выявлении возможных целей и проведении симуляций боевой обстановки.

Этот случай показывает, насколько глубоко передовые ИИ-системы уже встроены в оборонные процессы. Даже на фоне попыток администрации разорвать взаимодействие с компанией, Claude, по сообщениям, оставался интегрирован в рабочие процедуры военных.

В пятницу администрация Трампа поручила ведомствам прекратить работу с Anthropic и указала Минобороны рассматривать компанию как потенциальный риск для безопасности. Решение последовало после срыва переговоров по контракту: Anthropic, как утверждается, отказалась предоставить военным неограниченный доступ к использованию своего ИИ в любых законных сценариях, которые запрашивали представители оборонного ведомства.

Claude применяли в закрытых операциях

Ранее Anthropic получила многолетний контракт Пентагона на сумму до 200 млн долларов вместе с рядом крупных ИИ-лабораторий. Через партнерства, в том числе с Palantir и Amazon Web Services, Claude допустили к использованию в засекреченных разведывательных и операционных процессах. Также сообщается, что система применялась и в более ранних операциях, включая январскую миссию в Венесуэле, которая, по данным источников, завершилась захватом президента Николаса Мадуро.

Напряженность усилилась после того, как министр обороны Пит Хегсет потребовал разрешить неограниченное военное использование моделей компании. Генеральный директор Anthropic Дарио Амодеи, как сообщается, отклонил запрос, заявив, что некоторые сценарии выходят за этические рамки, которые компания не намерена пересекать, даже ценой потери госзаказов.

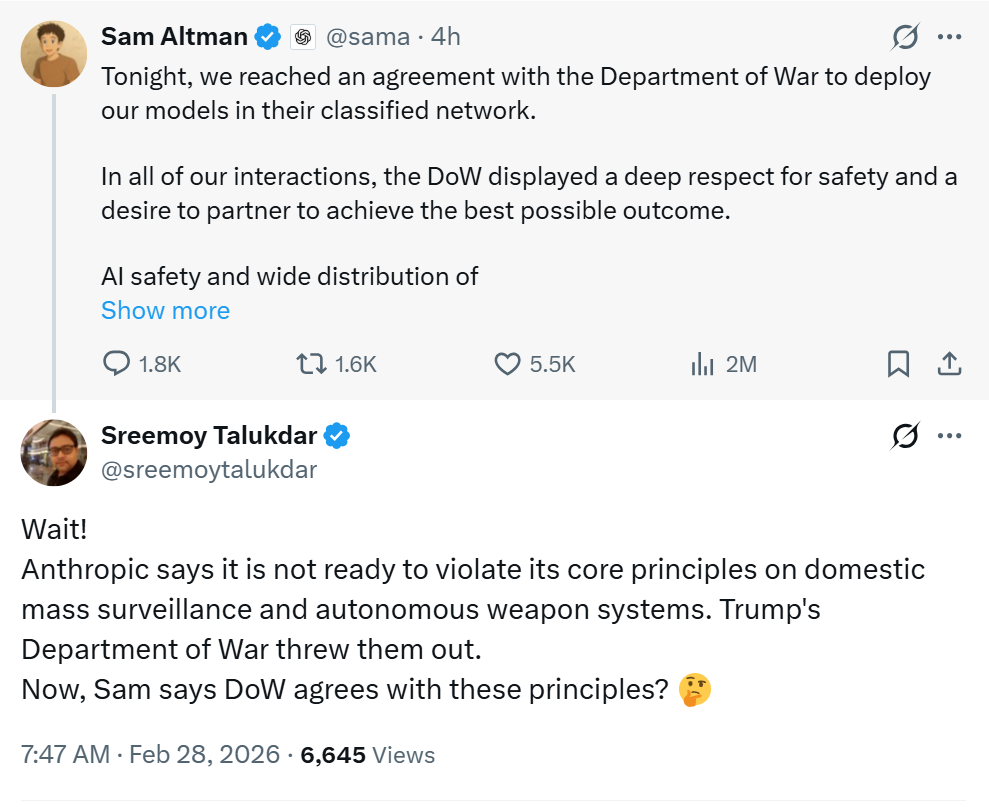

В ответ Пентагон начал подбирать замену и, по данным источников, договорился с OpenAI о развертывании ее моделей ИИ в засекреченных военных сетях.

Глава Anthropic раскритиковал запрет Пентагона

В субботнем интервью Дарио Амодеи заявил, что компания выступает против использования ее ИИ-моделей для массовой внутренней слежки и полностью автономного оружия. Он прокомментировал правительственную директиву США, в которой фирму назвали «риском для цепочки поставок» в оборонной сфере и запретили подрядчикам применять ее продукты.

Амодеи подчеркнул, что ряд применений выходит за фундаментальные границы, а решения в военной сфере, по его мнению, должны оставаться под контролем людей и не передаваться полностью машинам.

Источник: The Wall Street Journal