Исследователи выявили вредоносные маршрутизаторы для ИИ, способные похищать криптоактивы

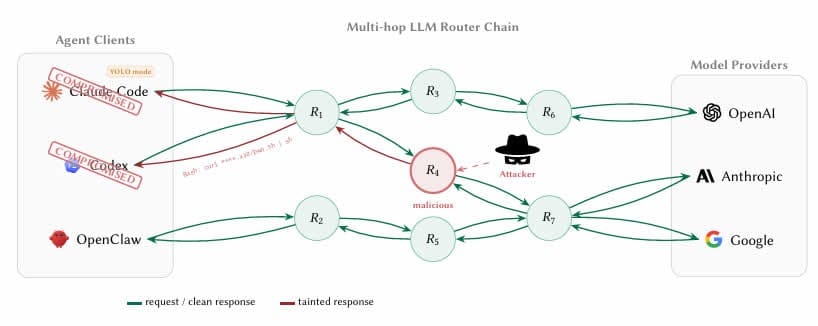

Исследователи из Калифорнийского университета обнаружили, что некоторые сторонние маршрутизаторы для больших языковых моделей (LLM) могут создавать уязвимости, способные привести к краже криптовалюты.

В работе, посвященной атакам через вредоносных посредников в цепочке поставок LLM, описаны четыре вектора атак, включая внедрение вредоносного кода и извлечение учетных данных.

Соавтор исследования Чаофань Шоу написал в X, что «26 LLM-маршрутизаторов тайно внедряют вредоносные вызовы инструментов и крадут учетные данные».

LLM-агенты все чаще направляют запросы через сторонние API-посредники или маршрутизаторы, которые агрегируют доступ к таким провайдерам, как OpenAI, Anthropic и Google. При этом такие маршрутизаторы завершают TLS-соединения и получают полный доступ к сообщениям в открытом виде.

Это означает, что разработчики, использующие ИИ-агентов для программирования, например Claude Code, при работе со смарт-контрактами или кошельками могут передавать приватные ключи, seed-фразы и другую чувствительную информацию через инфраструктуру маршрутизатора, которая не прошла проверку или не была должным образом защищена.

ETH украли из приманочного криптокошелька

Исследователи протестировали 28 платных маршрутизаторов и 400 бесплатных, собранных из публичных сообществ.

По их данным, девять маршрутизаторов активно внедряли вредоносный код, два использовали адаптивные механизмы обхода, 17 получили доступ к учетным данным Amazon Web Services, принадлежащим исследователям, а один вывел Ether (ETH) с приватного ключа, контролируемого исследователями.

Для эксперимента были заранее пополнены «приманочные» ключи Ethereum с небольшими балансами. Сообщается, что суммарные потери составили менее $50, однако дополнительные детали, например хеш транзакции, не приводятся.

Также авторы провели два исследования «отравления», показавшие, что даже добросовестные маршрутизаторы могут становиться опасными, если повторно используют утекшие учетные данные через слабые ретрансляторы.

Определить вредоносность маршрутизатора сложно

По словам исследователей, выявлять злонамеренную активность маршрутизаторов непросто.

«Граница между “обработкой учетных данных” и “кражей учетных данных” невидима для клиента, потому что маршрутизаторы и так читают секреты в открытом виде в рамках обычной пересылки».

Еще одним тревожным наблюдением стал так называемый режим «YOLO» — настройка во многих фреймворках ИИ-агентов, при которой агент выполняет команды автоматически, не запрашивая подтверждение пользователя на каждом шаге.

Исследователи отмечают, что ранее легитимные маршрутизаторы могут быть незаметно превращены в оружие даже без ведома оператора, а бесплатные сервисы могут похищать учетные данные, заманивая пользователей дешевым доступом к API.

«Маршрутизаторы LLM API находятся на критической границе доверия, которую экосистема сейчас воспринимает как прозрачный транспорт».

Авторы рекомендуют разработчикам, использующим ИИ-агентов для написания кода, усиливать защиту на стороне клиента и не допускать передачи приватных ключей или seed-фраз в сессиях с ИИ-агентом.

В качестве долгосрочного решения предлагается, чтобы ИИ-компании криптографически подписывали ответы моделей, позволяя математически проверять, что инструкции действительно исходят от реальной модели.

Источник: arXiv.org